AI e Compliance aziendale, la sfida della conformità per i dipartimenti e gli studi legali

L’intelligenza artificiale e la compliance aziendale. Due temi che possono sembrare distanti ma che, in realtà, rappresentano un mix sempre più attuale all’interno dello scenario applicativo delle nuove tecnologie in ambito aziendale. Consapevole di tale trend, Wolters Kluwer ha deciso di organizzare, presso la sede di Google Italia, il suo primo “Forum Legale”.

L’idea è quella di affrontare l’argomento “molto specifico con professionisti, istituzioni e accademici, per capire come vincere la sfida delle conformità per i legal department e studi legali” sottolinea Paola Maiorana, Direttrice della Scuola di formazione IPSOA, Wolters Kluwer Italia. “Il Forum si inserisce nell’ampio calendario di Wolters Kluwer che, da anni, tiene diversi forum (dal fiscale al lavoro, dal bilancio al controllo di gestione ed SGE) da cui sono persino nate nuove interpretazioni legislative”.

La spinta tecnologica attuale può dare a chi supporta i professionisti di accogliere la digitalizzazione e l’automazione, dentro piattaforme dedicate. “Ad esempio Kleos, la soluzione innovativa in cloud per la gestione dello studio legale ma anche One Legale, la banca dati online completa e aggiornata con legislazione, giurisprudenza, dottrina e formulari e la SuiteNextm il software gestionale per notai, con funzionalità specifiche per la gestione degli atti notarili, la redazione di documenti, la registrazione e la conservazione”.

Complessità crescente

A dare il benvenuto ai partecipanti è stato Carmelo Fontana, Senior Regional Counsel di Google. “Il tema della regolazione dell’intelligenza artificiale non riguarda più solo i giuristi. Si è diffuso, è diventato un elemento di discussione per tanti, quasi per tutti. Abbiamo scoperto una realtà accessibile a cui vanno applicate delle regole”. Fontana ha ricordato l’avvento dell’AI Pact, un punto di incontro focale per le aziende aderenti. L’AI Pact, o Patto per l’Intelligenza Artificiale, è un’iniziativa dell’Unione Europea che incoraggia le organizzazioni a prepararsi in anticipo per l’implementazione dell’AI Act, la futura legge europea sull’intelligenza artificiale.

Attraverso l’AI Pact, le aziende si impegnano volontariamente ad adottare pratiche responsabili nello sviluppo e nell’utilizzo dell’IA, anche prima che l’AI Act entri in vigore. “Questi impegni includono l’adozione di strategie di governance dell’IA, la promozione della trasparenza e della spiegabilità dei sistemi di IA, e la garanzia della sicurezza e della privacy degli utenti. L’AI Pact mira a creare un clima di fiducia, dimostrando che le aziende sono disposte ad agire responsabilmente e a contribuire a uno sviluppo dell’IA che sia sicuro, affidabile e rispettoso dei diritti fondamentali”.

Il perché del Forum Legale

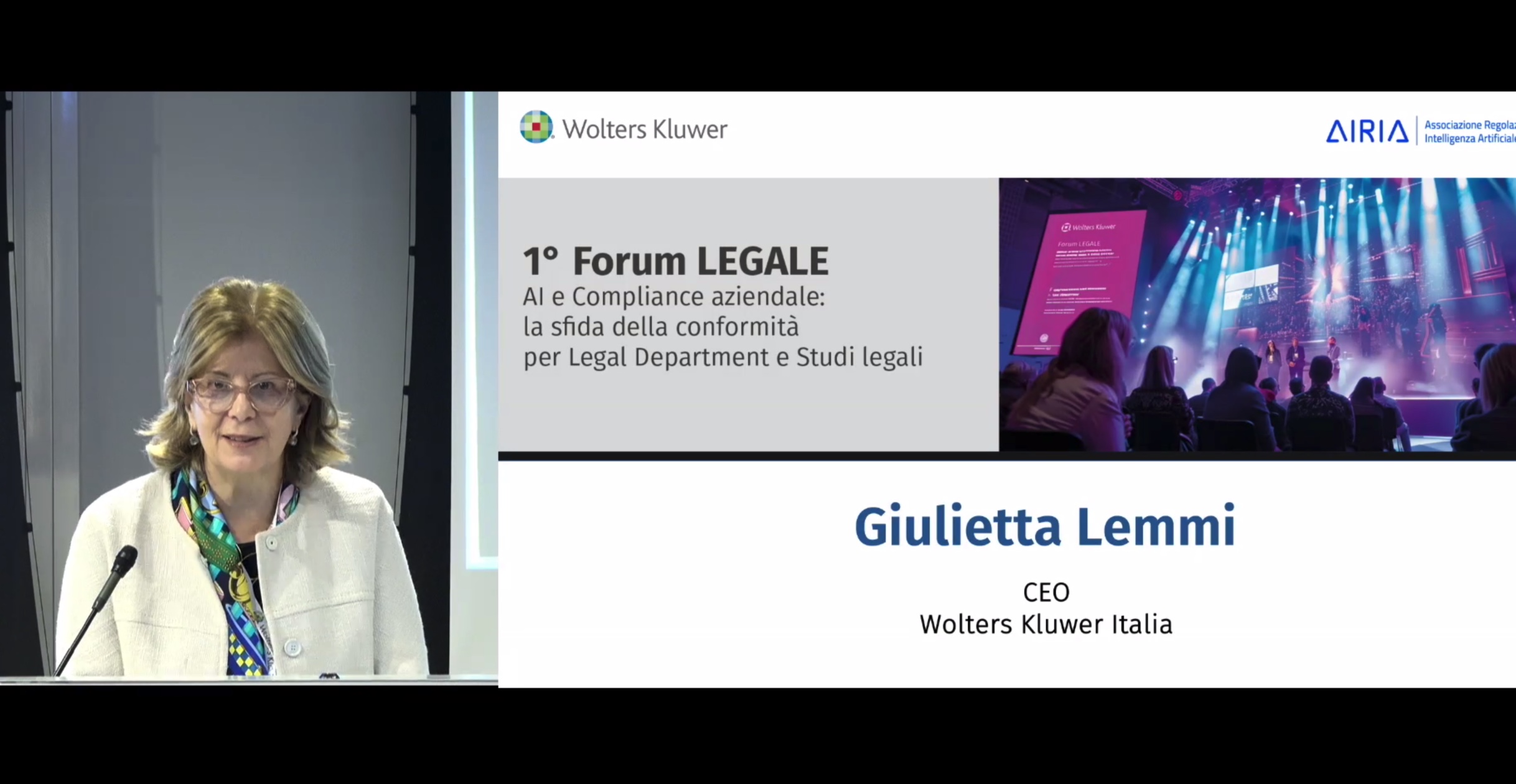

Scegliere gli argomenti del primo Forum Legale di Wolters non è stato difficile. Questa è l’opinione di Giulietta Lemmi, CEO di Wolters Kluwer Italia. “Sarà importante comprendere l’armonizzazione dei diversi tipi di normativi che si interessano di IA – spiega Lemmi – questo crea una complessità che va gestita. Siamo nell’era di una rivoluzione tecnologica che crea vantaggi per chi la sa sfruttare ma non possiamo considerarla in modo isolato. C’è necessità di maggiore interazione, anche all’interno delle imprese. Ed è per questo che parliamo di compliance aziendale”.

Dati sicuri, affidabilità dei risultati, rischi etici. Sono tanti gli elementi messi sul piatto come ingredienti che vanno ad arricchire quell’enorme contenitore che si chiama intelligenza artificiale. “Abbiamo in corso vari test, in ambienti protetti, in cui usiamo l’IA all’interno dei nostri contenuti. Un panorama da cui potrebbero trarre beneficio coloro che generano atti, bozze, contatto con i clienti. Ci siamo confrontati per questi progetti, rendendoci conto di una complessità forte, sia tecnologica che organizzativa” conclude Lemmi.

“Un paese che non ha la cultura del digitale non può comprendere i vantaggi reali di una tecnologia dirompente”. Per questo, secondo Edoardo Raffiotta, Professore di diritto istituzione di Milano Bicocca e Avvocato di Counsel LCA, l’Unione Europea ha deciso di mettere i paesi del blocco in linea con il trasformare l’etica in diritto, ossia declinare le previsioni in applicabilità. “Le aziende non devono essere scoraggiate. Non tutti possono fregiarsi di una vera attenzione alle regole ma l’IA Act consente di iniziare ad aderire alle regole, indipendentemente dal rischio di multe”. Nella governance dell’IA, il ruolo del Garante è fondamentale.

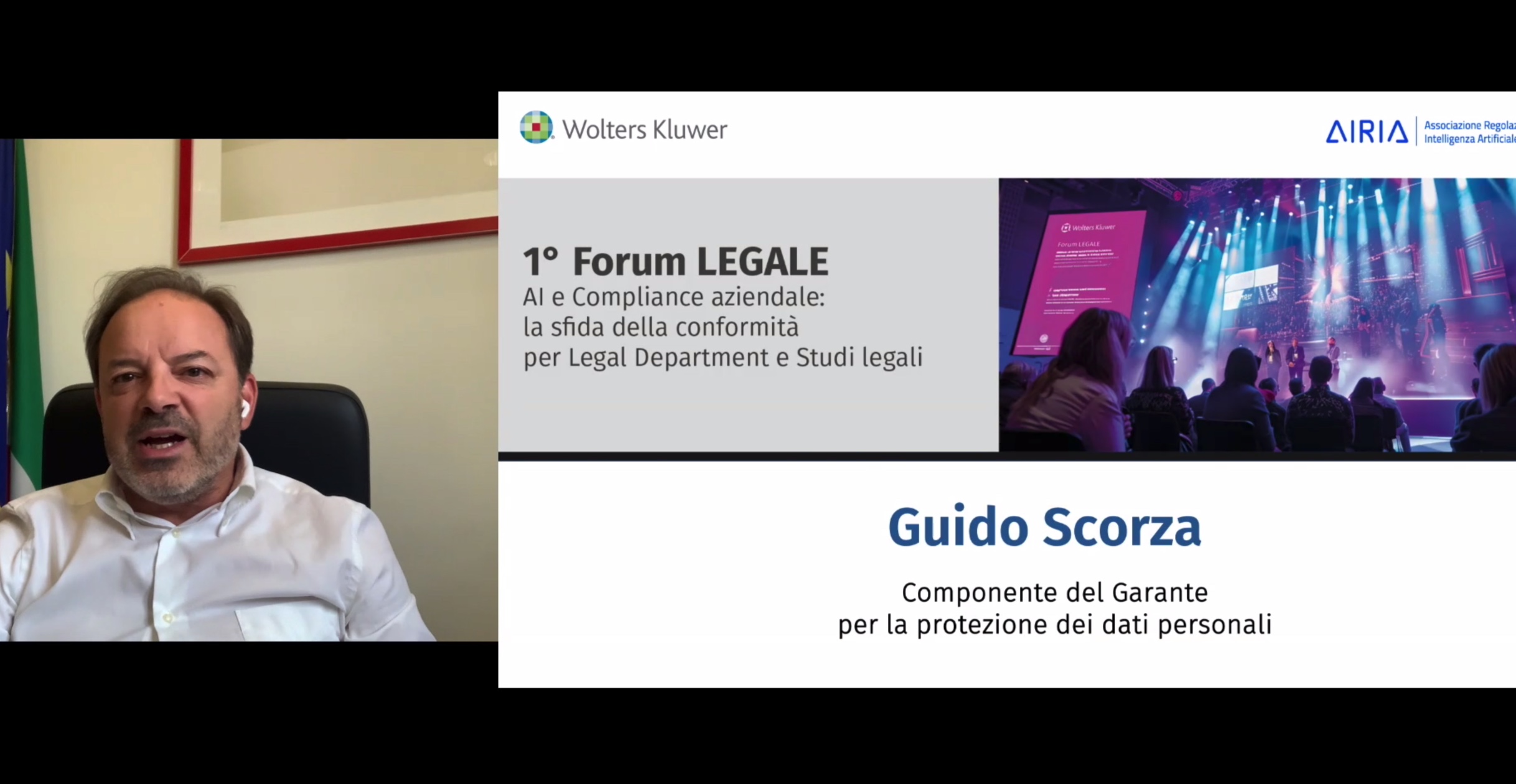

“La società digitale in cui viviamo ci pone delle criticità molte più alte che in passato. La prima riguarda i tempi. L’innovazione corre veloce, più delle normative. Il rischio è quello che la tecnologia diventa essi stessa forma di regolamentazione e, se accadesse, la tecnocrazia soppianterebbe la democrazia. L’IA Act, che entrerà in vigore nel 2026 vedrà una storia diversa dell’applicazione degli algortimi. Come arrivare a tale data? Cambiare il metodo con cui si governa il presente” le parole di Guido Scorza, Componente del Garante per la protezione dei dati personali, collegato da Roma.

“La seconda sfida riguarda lo spazio. Come si fa a garantire che una stessa tcnologia sia oggetto di una stessa regola a livello globale. Non c’è risposta ma siamo davanti a un bivio: o si cede la sovranità dinanzi alla comunità o ci ritroveremo a vederci espropriati dai mercati e industre mondiali, che difficilmente piegheranno le loro tecnologie per fini superiori”. L’ultima sfida ha un nome: democrazia. “Come ci si convince che c’è l’ipotesi di poter rinuciare ai benefici della tecnologia per non pagare un prezzo troppo elevato in termini di libertà? Bisogna cominciare a investire per davvero nella formazione delle persone. Oggi si spende più ad addestrare gli algoritmi piuttosto che ad aumentare la comprensione di essi da parte del consumatore e dei professionisti. Tra tanti dubbi c’è una certezza. solo un sistema integrato, costituito da una pluralità di soggetti e agenzie, può garantire al nostro paese di avere dinanzi a sé ancora molti anni di democrazia e non di tecnocrazia”.

Nell’ambito del possibile pregiudizio per la sicurezza nazionale nel cyberspazio, è nata anni fa l’ACN, l’Agenzia perla Cybersicurezza italiana. “Da cittadini, imprenditori, studenti, docenti, ciascuno deve collaborare per rendere l’ambiente digitale uno spazio sicuro” conferma Marcello Albergoni, Vice Capo di Gabinetto dell’ACN. “Nella su attività di regolamentazione, ACN ha un approccio di ascolto delle esigenze, aperto al confronto e poter decidere con un patrimonio informativo arricchito. Nello specifico dei rapporti con il Garante Privacy, l’Agenzia nasce con la previsione di comunicare in maniera linea e continua con il Garante. Quando si parla di sicurezza, anche nel DDL in materia di intelligenza artificiale, si legge come sia fondamentale il coordinamento. Non ci affacciamo per la prima volta all’argomento ma è tutto in divenire e quindi vedremo dove arriveremo con la legislazione”.