Segment Anything non ha bisogno di addestramento per sapere cosa c’è in una foto

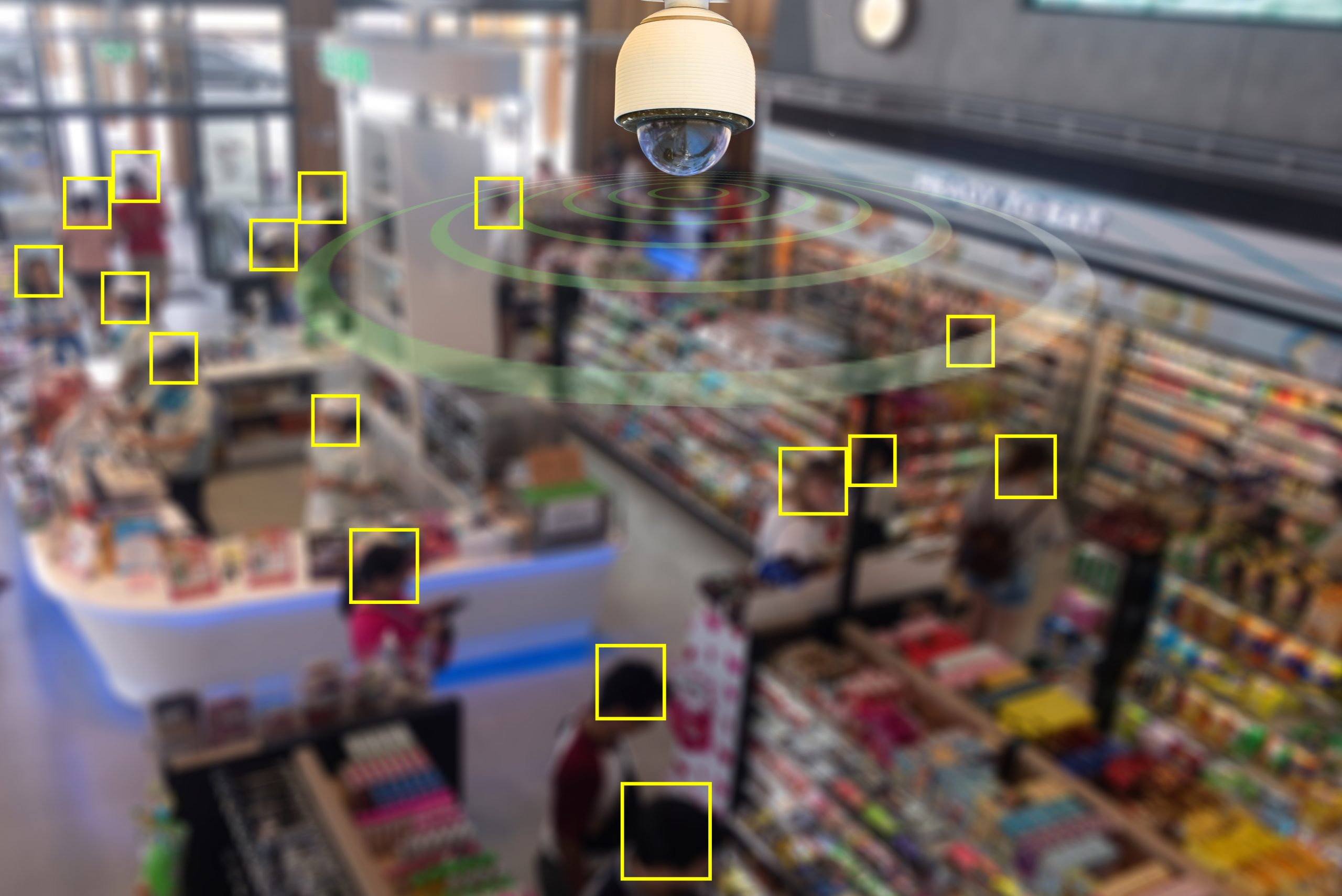

Normalmente l’intelligenza artificiale deve essere addestrata su materiale esistente per rilevare gli oggetti, ma Meta ha condiviso modo per far si che la tecnologia possa procedere in autonomia, senza l’intervento umano. Il gigante dei social media ha pubblicato un modello di intelligenza artificiale chiamato “Segment Anything” che può rilevare oggetti in immagini e video anche se non fanno parte del suo set di addestramento. È possibile selezionare gli elementi facendo clic su di essi o utilizzando prompt di testo in formato libero. Come spiega Reuters, si può digitare la parola “gatto” e guardare l’IA evidenziare tutti i felini in una determinata foto.

Il modello può anche funzionare in tandem con altri modelli. Ad esempio, per aiutare a ricostruire un oggetto in 3D, utilizzando una singola immagine, o disegnare progetti per la realtà mista. Sia il modello AI che un set di dati saranno scaricabili con una licenza non commerciale, il che vuol dire che gli utenti non potranno usarlo per prodotti e servizi da vendere. Il motivo è che tutto il lavoro che c’è dietro è principalmente per la ricerca e l’ampliamento dell’accesso alla tecnologia. In questo momento, Meta utilizza uno strumento in qualche modo simile per moderare i contenuti vietati sui social, consigliare post e taggare le foto. Gli sviluppatori riconoscono che il modello esistente è imperfetto. Potrebbe perdere dettagli più fini e non è accurato nel rilevare i confini come alcuni modelli. E mentre Segment Anything è in grado di gestire i prompt in tempo reale, si blocca quando è coinvolta un’elaborazione delle immagini impegnativa. È probabile che alcuni strumenti di intelligenza artificiale più specializzati superino questo modello nei rispettivi campi, ma ad oggi quello di Meta segna una nuova svolta nell’utilizzo dell’IA generativa.